Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

sunny madra

COO/President Cloud, HW, Sales, Ops @GroqInc 🇺🇸 forrige co-f (@definitiveio acq. av groq, autonom acq. av @ford, xtreme labs acq. av pivotal/@vmware)

Jeg elsker hvordan @karpathy deler metodikken 🙏🏽 sin

Andrej Karpathy16 timer siden

Fortsetter reisen mot optimal LLM-assistert kodeopplevelse. Spesielt opplever jeg at i stedet for å begrense meg til en perfekt ting, diversifiserer bruken min stadig mer over noen få arbeidsflyter som jeg "syr sammen" fordeler/ulemper med:

Personlig fortsetter brødet og smøret (~75%?) av min LLM-hjelp å være bare (markør) fanen fullført. Dette er fordi jeg synes at det å skrive konkrete biter av kode/kommentarer selv og i riktig del av koden er en høy båndbredde måte å kommunisere "oppgavespesifikasjon" til LLM, det vil si at det først og fremst handler om oppgavespesifikasjonsbiter - det tar for mange biter og for mye ventetid for å kommunisere hva jeg vil ha i tekst, Og det er raskere å bare demonstrere det i koden og på riktig sted. Noen ganger er fanemodellen irriterende, så jeg slår den mye på/av.

Neste lag opp er å fremheve en konkret kodebit og be om en slags modifikasjon.

Neste lag opp er Claude Code / Codex / etc, som kjører på siden av Cursor, som jeg går til for større biter av funksjonalitet som også er ganske enkle å spesifisere i en ledetekst. Disse er supernyttige, men fortsatt blandet generelt og litt frustrerende til tider. Jeg kjører ikke i YOLO-modus fordi de kan gå utenfor banen og gjøre dumme ting du ikke ønsket/trenger, og jeg ESC ganske ofte. Jeg har heller ikke lært å være produktiv ved å bruke mer enn én forekomst parallelt - en føles allerede vanskelig nok. Jeg har ikke funnet ut en god måte å beholde CLAUDE på[.]MD god eller oppdatert. Jeg må ofte gjøre en omgang "oppryddinger" for kodestil, eller spørsmål om kodesmak. F.eks. er de for defensive og bruker ofte for mye prøv/fang-utsagn, de overkompliserer ofte abstraksjoner, de overdriver kode (f.eks. en nestet hvis-den-ellers-konstruksjon når en listeforståelse eller en en-liner hvis-så-ellers-ellers ville fungere), eller de dupliserer kodebiter i stedet for å lage en fin hjelpefunksjon, sånne ting... de har i utgangspunktet ikke smakssans. De er uunnværlige i tilfeller der jeg kommer inn i et mer vibe-kodende territorium der jeg er mindre kjent (f.eks. skrive litt rust nylig, eller sql-kommandoer, eller noe annet jeg har gjort mindre av før). Jeg prøvde også CC for å lære meg ting ved siden av koden den skrev, men det fungerte ikke i det hele tatt - den vil egentlig bare skrive kode mye mer enn den vil forklare noe underveis. Jeg prøvde å få CC til å gjøre hyperparameterjustering, noe som var veldig morsomt. De er også veldig nyttige i alle slags engangsvisualiseringer eller verktøy med lavere innsats eller feilsøkingskode som jeg aldri ville skrevet ellers fordi det ville tatt altfor lang tid. F.eks. kan CC hamre ut 1,000 linjer med engangs omfattende visualisering/kode bare for å identifisere en spesifikk feil, som blir slettet rett etter at vi finner den. Det er koden etter knapphet - du kan bare opprette og deretter slette tusenvis av linjer med supertilpasset, super flyktig kode nå, det er ok, det er ikke denne dyrebare kostbare tingen lenger.

Det siste forsvarslaget er GPT5 Pro, som jeg går til for de vanskeligste tingene. F.eks. har det skjedd med meg noen ganger nå at jeg / Cursor / CC alle sitter fast på en feil i 10 minutter, men når jeg kopierer og limer inn hele greia til 5 Pro, går den av i 10 minutter, men finner faktisk en veldig subtil feil. Den er veldig sterk. Den kan grave opp alle slags esoteriske dokumenter og papirer og slikt. Jeg har også brukt den til andre mer kjøttfulle oppgaver, for eksempel forslag til hvordan man kan rydde opp i abstraksjoner (blandede resultater, noen ganger gode ideer, men ikke alle), eller en hel litteraturgjennomgang rundt hvordan folk gjør dette eller hint, og den kommer tilbake med gode relevante ressurser/tips.

Uansett, koding føles helt blåst opp med muligheter på tvers av en rekke "typer" koding og deretter en rekke verktøy med sine fordeler/ulemper. Det er vanskelig å unngå følelsen av angst rundt å ikke være på grensen av hva som er kollektivt mulig, derav tilfeldig søndagsdusj av tanker og en god mengde nysgjerrighet på hva andre finner.

3,23K

Etter den menneskelige vaskemaskinen er neste trinn:

Massimo24. aug., 14:19

Japan viser frem en "menneskelig vaskemaskin" som kan vaske og tørke deg på 15 minutter

1,93K

Bare noen få mennesker forstår omfanget av databehandlingsbehov ...

Elon Musk24. aug., 06:34

Etter å ha tenkt litt mer på det, tror jeg det tilsvarende tallet på 50 millioner H100 på 5 år er omtrent riktig.

Til slutt milliarder.

3,11K

🎯🎯🎯

De største premiene noensinne er å vinne

Fred Krueger23. aug., 13:42

Mye av «Mag 7» er å vinne:

- Google er den nye AOL. Ingen søker lenger. De GPT det.

- Microsoft selger fortsatt forferdelige utdaterte produkter. Deres eneste redning: de investerte i åpen AI

- Apple blåste det fullstendig med Siri og Apple Intelligence. Vision Pro døde en overpriset død.

- Meta melker fortsatt Facebook, noe som objektivt sett suger. Deres «MetaVerse» var en spøk.

Amazon, TSLA og NVDA ser sterke ut, men de andre 4 ser ut til å ha problemer.

Selvfølgelig, sammenlignet med Europa er alt dette fantastisk. Nestlé har oppfunnet noen nye yoghurter, og LVMH har noen nye overprisede håndvesker. Belgia har i mellomtiden innført lover som regulerer flaskekorker.

AI kommer og tar ingen fanger.

2,56K

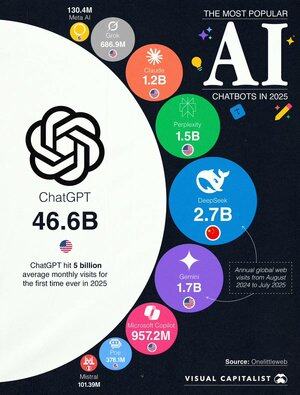

Større enn alle til sammen

Wall St Engine23. aug., 19:21

ChatGPT overgår absolutt annenhver AI-chatbot med 46.6 milliarder årlige besøk; Det er mer enn 83 % av den totale trafikken på tvers av topp 10.

Til sammenligning:

DeepSeek: 2.7B

Tvillingene: 1.7B

Forvirring: 1,5 milliarder

Claude: 1.2B

Microsoft Copilot: 957 millioner

Grov: 687M

Poe: 378M

Meta AI: 130M

Mistral: 101M

2,6K

«Få 50 % rabatt på bufrede inndatatokener, pluss lavere ventetid og automatisk prefiksmatching»

Roo Code23. aug., 08:18

🚀 Rask caching er her for Kimi K2-modellen på @GroqInc!

Få 50 % rabatt på bufrede inndatatokener, pluss lavere ventetid og automatisk prefiksmatching.

Begynn å kode raskere, billigere og jevnere i Roo Code i dag.

🔗 Opplev forskjellen:

7,18K

Topp

Rangering

Favoritter

Trendende onchain

Trendende på X

Nylig toppfinansiering

Mest lagt merke til