Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Não vi ninguém tão imerso na narrativa de Robótica x IA como o Trissy

Felizmente, sei que devo alocar pesadamente quando o autismo dele aparece

Codec codificado

23/08, 18:30

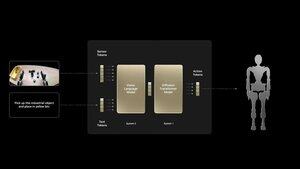

Você verá modelos de fundação para Humanoides utilizando continuamente uma arquitetura estilo Sistema 2 + Sistema 1, que é na verdade inspirada na cognição humana.

A maioria dos modelos de visão-linguagem-ação (VLA) hoje são construídos como sistemas multimodais centralizados que lidam com percepção, linguagem e ação dentro de uma única rede.

A infraestrutura do Codec é perfeita para isso, pois trata cada Operador como um módulo isolado. Isso significa que você pode ativar múltiplos Operadores em paralelo, cada um executando seu próprio modelo ou tarefa, enquanto os mantém encapsulados e coordenados através da mesma arquitetura.

Robôs e Humanoides, em geral, tipicamente têm múltiplos cérebros, onde um Operador pode lidar com o processamento de visão, outro com o equilíbrio, outro fazendo planejamento de alto nível, etc., que podem ser todos coordenados através do sistema do Codec.

O modelo de fundação da Nvidia, Issac GR00T N1, utiliza a arquitetura de dois módulos Sistema 2 + Sistema 1. O Sistema 2 é um modelo de visão-linguagem (uma versão do PaLM ou similar, multimodal) que observa o mundo através das câmeras do robô e ouve instruções, então faz um planejamento de alto nível.

O Sistema 1 é uma política de transformador de difusão que pega esse plano e o transforma em movimentos contínuos em tempo real. Você pode pensar no Sistema 2 como o cérebro deliberativo e no Sistema 1 como o controlador corporal instintivo. O Sistema 2 pode gerar algo como "mova-se para o copo vermelho, agarre-o, e então coloque-o na prateleira," e o Sistema 1 gerará as trajetórias detalhadas das articulações para as pernas e braços executarem cada passo suavemente.

O Sistema 1 foi treinado com uma tonelada de dados de trajetória (incluindo demonstrações teleoperadas por humanos e dados simulados fisicamente) para dominar movimentos finos, enquanto o Sistema 2 foi construído em um transformador com pré-treinamento na internet (para compreensão semântica).

Essa separação entre raciocínio e ação é muito poderosa para a NVIDIA. Isso significa que o GR00T pode lidar com tarefas de longo prazo que requerem planejamento (graças ao Sistema 2) e também reagir instantaneamente a perturbações (graças ao Sistema 1).

Se um robô está carregando uma bandeja e alguém empurra a bandeja, o Sistema 1 pode corrigir o equilíbrio imediatamente, em vez de esperar que o mais lento Sistema 2 perceba.

O GR00T N1 foi um dos primeiros modelos de fundação de robótica disponíveis publicamente, e rapidamente ganhou tração.

Pronto para uso, ele demonstrou habilidade em muitas tarefas em simulação, conseguia agarrar e mover objetos com uma ou duas mãos, passar itens entre suas mãos e realizar tarefas de múltiplos passos sem qualquer programação específica para a tarefa. Como não estava vinculado a uma única encarnação, os desenvolvedores mostraram que ele funcionava em diferentes robôs com ajustes mínimos.

Isso também é verdade para o Helix (o modelo de fundação da Figure), que utiliza esse tipo de arquitetura. O Helix permite que dois robôs ou múltiplas habilidades operem, o Codec poderia habilitar um cérebro multiagente executando vários Operadores que compartilham informações.

Esse design de "pódio isolado" significa que cada componente pode ser especializado (assim como Sistema 1 vs Sistema 2) e até mesmo desenvolvido por diferentes equipes, ainda assim podem trabalhar juntos.

É uma abordagem única no sentido de que o Codec está construindo a pilha de software profunda para suportar essa inteligência modular e distribuída, enquanto a maioria dos outros foca apenas no modelo de IA em si.

O Codec também aproveita grandes modelos pré-treinados. Se você está construindo uma aplicação robótica sobre isso, pode conectar um modelo de fundação OpenVLA ou Pi Zero como parte do seu Operador. O Codec fornece os conectores, fácil acesso a feeds de câmera ou APIs de robô, para que você não precise escrever o código de baixo nível para obter imagens da câmera de um robô ou enviar comandos de velocidade para seus motores. Tudo isso é abstraído por trás de um SDK de alto nível.

Uma das razões pelas quais estou tão otimista em relação ao Codec é exatamente o que descrevi acima. Eles não estão perseguindo narrativas, a arquitetura é construída para ser a cola entre modelos de fundação, e suporta sem atrito sistemas de múltiplos cérebros, o que é crítico para a complexidade humanoide.

Como estamos tão no início dessa tendência, vale a pena estudar os designs dos líderes da indústria e entender por que eles funcionam. A robótica é difícil de entender, dadas as camadas entre hardware e software, mas uma vez que você aprende a dividir cada seção em partes, torna-se muito mais fácil de digerir.

Pode parecer uma perda de tempo agora, mas este é o mesmo método que me deu uma vantagem durante a época da IA e por que eu estava à frente em tantos projetos. Torne-se disciplinado e aprenda quais componentes podem coexistir e quais componentes não escalam.

Isso trará dividendos nos próximos meses.

Deca Trillions ( $CODEC ) codificado.

5,06K

Top

Classificação

Favoritos