Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

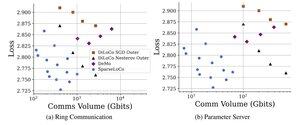

Vi presenterar SparseLoCo: en kommunikationseffektiv metod för LLM-förträning.

TL; DR: Vi utnyttjar Top-k-sparsifiering + felåterkoppling med DiLoCos sällsynta yttre steg – som endast kommunicerar 1–3 % gradienter med 2-bitars kvantisering – vilket överträffar DiLoCo och DeMo. 1/N,

ArXiv:

Github:

38,1K

Topp

Rankning

Favoriter