Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

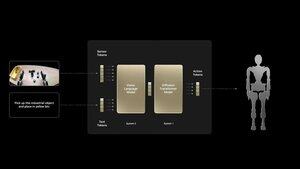

Vedrai modelli di base per i Humanoidi che utilizzano continuamente un'architettura in stile Sistema 2 + Sistema 1, ispirata alla cognizione umana.

La maggior parte dei modelli visione-linguaggio-azione (VLA) di oggi sono costruiti come sistemi multimodali centralizzati che gestiscono percezione, linguaggio e azione all'interno di una singola rete.

L'infrastruttura di Codec è perfetta per questo, poiché tratta ogni Operatore come un modulo isolato. Ciò significa che puoi avviare più Operatori in parallelo, ciascuno eseguendo il proprio modello o compito, mantenendoli incapsulati e coordinati attraverso la stessa architettura.

I robot e i Humanoidi in generale hanno tipicamente più cervelli, dove un Operatore potrebbe gestire l'elaborazione visiva, un altro gestire l'equilibrio, un altro fare pianificazione ad alto livello, ecc., che possono tutti essere coordinati attraverso il sistema di Codec.

Il modello di base di Nvidia Issac GR00T N1 utilizza l'architettura a due moduli Sistema 2 + Sistema 1. Il Sistema 2 è un modello visione-linguaggio (una versione di PaLM o simile, multimodale) che osserva il mondo attraverso le telecamere del robot e ascolta le istruzioni, quindi elabora un piano ad alto livello.

Il Sistema 1 è una politica di diffusione trasformativa che prende quel piano e lo trasforma in movimenti continui in tempo reale. Puoi pensare al Sistema 2 come al cervello deliberativo e al Sistema 1 come al controllore corporeo istintivo. Il Sistema 2 potrebbe produrre qualcosa come "muoviti verso la tazza rossa, afferrala, poi posala sullo scaffale," e il Sistema 1 genererà le traiettorie articolari dettagliate per le gambe e le braccia per eseguire ogni passaggio in modo fluido.

Il Sistema 1 è stato addestrato su tonnellate di dati di traiettoria (inclusi dimostrazioni teleoperate da umani e dati simulati fisicamente) per padroneggiare i movimenti fini, mentre il Sistema 2 è stato costruito su un trasformatore con pre-addestramento su internet (per la comprensione semantica).

Questa separazione tra ragionamento e azione è molto potente per NVIDIA. Significa che GR00T può gestire compiti a lungo termine che richiedono pianificazione (grazie al Sistema 2) e anche reagire istantaneamente a perturbazioni (grazie al Sistema 1).

Se un robot sta trasportando un vassoio e qualcuno lo spinge, il Sistema 1 può correggere immediatamente l'equilibrio invece di aspettare che il più lento Sistema 2 se ne accorga.

GR00T N1 è stato uno dei primi modelli di base per la robotica disponibili pubblicamente, e ha rapidamente guadagnato trazione.

Fuori dalla scatola, ha dimostrato abilità in molti compiti in simulazione, poteva afferrare e muovere oggetti con una mano o due, passare oggetti tra le sue mani e svolgere compiti a più fasi senza alcuna programmazione specifica per il compito. Poiché non era legato a un'unica incarnazione, gli sviluppatori hanno dimostrato che funzionava su diversi robot con minime modifiche.

Questo è vero anche per Helix (il modello di base di Figure) che utilizza questo tipo di architettura. Helix consente a due robot o più abilità di operare, Codec potrebbe abilitare un cervello multi-agente eseguendo diversi Operatori che condividono informazioni.

Questo design "isolato" significa che ogni componente può essere specializzato (proprio come il Sistema 1 rispetto al Sistema 2) e persino sviluppato da team diversi, eppure possono lavorare insieme.

È un approccio unico nel senso che Codec sta costruendo lo stack software profondo per supportare questa intelligenza modulare e distribuita, mentre la maggior parte degli altri si concentra solo sul modello AI stesso.

Codec sfrutta anche grandi modelli pre-addestrati. Se stai costruendo un'applicazione robotica su di esso, potresti collegare un modello di base OpenVLA o Pi Zero come parte del tuo Operatore. Codec fornisce i connettori, un facile accesso ai feed delle telecamere o alle API dei robot, quindi non devi scrivere il codice di basso livello per ottenere immagini dalla telecamera di un robot o per inviare comandi di velocità ai suoi motori. È tutto astratto dietro un SDK di alto livello.

Uno dei motivi per cui sono così ottimista su Codec è esattamente ciò che ho delineato sopra. Non stanno inseguendo narrazioni, l'architettura è costruita per essere la colla tra i modelli di base, e supporta senza attriti sistemi multi-cervello, il che è critico per la complessità umanoide.

Poiché siamo ancora all'inizio di questa tendenza, vale la pena studiare i design dei leader del settore e capire perché funzionano. La robotica è difficile da afferrare date le sovrapposizioni tra hardware e software, ma una volta che impari a scomporre ogni sezione pezzo per pezzo, diventa molto più facile da digerire.

Potrebbe sembrare una perdita di tempo ora, ma questo è lo stesso metodo che mi ha dato un vantaggio durante la stagione AI e perché ero in anticipo su così tanti progetti. Diventa disciplinato e impara quali componenti possono coesistere e quali componenti non scalano.

Ne trarrai vantaggi nei prossimi mesi.

Deca Trillions ( $CODEC ) codificato.

8,55K

Principali

Ranking

Preferiti