Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

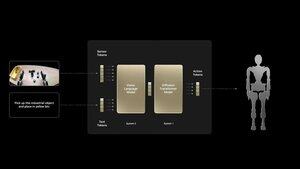

Sie werden sehen, dass Fundamentmodelle für Humanoide kontinuierlich eine System 2 + System 1 Architektur verwenden, die tatsächlich von der menschlichen Kognition inspiriert ist.

Die meisten Vision-Language-Action (VLA) Modelle von heute sind als zentrale multimodale Systeme aufgebaut, die Wahrnehmung, Sprache und Handlung innerhalb eines einzigen Netzwerks verarbeiten.

Die Infrastruktur von Codec ist perfekt dafür, da sie jeden Operator als einen isolierten Modul behandelt. Das bedeutet, dass Sie mehrere Operatoren parallel starten können, wobei jeder sein eigenes Modell oder seine eigene Aufgabe ausführt, während sie durch dieselbe Architektur gekapselt und koordiniert bleiben.

Roboter und Humanoide im Allgemeinen haben typischerweise mehrere Gehirne, wobei ein Operator die Bildverarbeitung übernimmt, ein anderer das Gleichgewicht, ein weiterer die hochrangige Planung usw., die alle durch das System von Codec koordiniert werden können.

Nvidias Fundamentmodell Issac GR00T N1 verwendet die zwei Modul System 2 + System 1 Architektur. System 2 ist ein Vision-Language-Modell (eine Version von PaLM oder ähnlich, multimodal), das die Welt durch die Kameras des Roboters beobachtet und Anweisungen hört, um dann einen hochrangigen Plan zu erstellen.

System 1 ist eine Diffusions-Transformator-Politik, die diesen Plan nimmt und ihn in kontinuierliche Bewegungen in Echtzeit umsetzt. Man kann sich System 2 als das überlegte Gehirn und System 1 als den instinktiven Körpercontroller vorstellen. System 2 könnte etwas ausgeben wie „bewege dich zur roten Tasse, greife sie, und stelle sie dann auf das Regal“, und System 1 wird die detaillierten Gelenktrajektorien für die Beine und Arme generieren, um jeden Schritt reibungslos auszuführen.

System 1 wurde mit einer Menge Trajektoriendaten (einschließlich menschlicher teleoperierter Demos und physiksimulierten Daten) trainiert, um feine Bewegungen zu meistern, während System 2 auf einem Transformator mit Internet-Vortraining (für semantisches Verständnis) aufgebaut wurde.

Diese Trennung von Denken und Handeln ist sehr mächtig für NVIDIA. Das bedeutet, dass GR00T langfristige Aufgaben, die Planung erfordern (dank System 2), bewältigen kann und auch sofort auf Störungen reagieren kann (dank System 1).

Wenn ein Roboter ein Tablett trägt und jemand das Tablett anstößt, kann System 1 das Gleichgewicht sofort korrigieren, anstatt auf das langsamere System 2 zu warten, um es zu bemerken.

GR00T N1 war eines der ersten öffentlich verfügbaren Fundamentmodelle für Robotik und gewann schnell an Bedeutung.

Out of the box zeigte es Fähigkeiten in vielen Aufgaben in Simulationen, es konnte Objekte mit einer oder zwei Händen greifen und bewegen, Gegenstände zwischen seinen Händen übergeben und mehrstufige Aufgaben ohne spezifische Programmierung ausführen. Da es nicht an eine einzige Verkörperung gebunden war, zeigten Entwickler, dass es auf verschiedenen Robotern mit minimalen Anpassungen funktionierte.

Das gilt auch für Helix (das Fundamentmodell von Figure), das diese Art von Architektur verwendet. Helix ermöglicht es, dass zwei Roboter oder mehrere Fähigkeiten operieren, Codec könnte ein Multi-Agenten-Gehirn ermöglichen, indem mehrere Operatoren betrieben werden, die Informationen teilen.

Dieses "isolierte Pod"-Design bedeutet, dass jede Komponente spezialisiert werden kann (genau wie System 1 vs. System 2) und sogar von verschiedenen Teams entwickelt werden kann, dennoch können sie zusammenarbeiten.

Es ist ein einzigartiger Ansatz, da Codec den tiefen Software-Stack aufbaut, um diese modulare, verteilte Intelligenz zu unterstützen, während die meisten anderen sich nur auf das KI-Modell selbst konzentrieren.

Codec nutzt auch große vortrainierte Modelle. Wenn Sie eine Roboteranwendung darauf aufbauen, könnten Sie ein OpenVLA oder ein Pi Zero Fundamentmodell als Teil Ihres Operators einfügen. Codec bietet die Anschlüsse, einfachen Zugang zu Kamerafeeds oder Roboter-APIs, sodass Sie den Low-Level-Code nicht schreiben müssen, um Bilder von der Kamera eines Roboters zu erhalten oder Geschwindigkeitsbefehle an seine Motoren zu senden. Alles ist hinter einem hochrangigen SDK abstrahiert.

Einer der Gründe, warum ich so optimistisch gegenüber Codec bin, ist genau das, was ich oben skizziert habe. Sie verfolgen keine Narrative, die Architektur ist so gebaut, dass sie der Kleber zwischen Fundamentmodellen ist, und sie unterstützt reibungslos Multi-Gehirn-Systeme, was für die Komplexität von Humanoiden entscheidend ist.

Da wir in diesem Trend noch so früh sind, ist es wert, die Designs von Branchenführern zu studieren und zu verstehen, warum sie funktionieren. Robotik ist schwer zu begreifen, angesichts der Schichten über Hardware und Software, aber sobald Sie lernen, jeden Abschnitt Stück für Stück zu zerlegen, wird es viel einfacher zu verdauen.

Es mag sich jetzt wie Zeitverschwendung anfühlen, aber dies ist dieselbe Methode, die mir einen Vorsprung während der AI-Saison verschaffte und warum ich bei so vielen Projekten frühzeitig war. Werden Sie diszipliniert und lernen Sie, welche Komponenten koexistieren können und welche Komponenten nicht skalieren.

Es wird sich in den kommenden Monaten auszahlen.

Deca Trillions ( $CODEC ) kodiert.

8,59K

Top

Ranking

Favoriten