Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

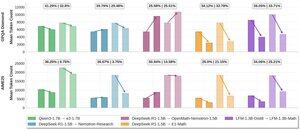

Enthousiast om inzichten te delen in ons werk op het gebied van efficiënt redeneren @LiquidAI_ :

We veranderen een algemeen chatmodel van 1,3 miljard in een sterke wiskundige redenering die beknopt blijft. SFT op gecureerde CoT-sporen ontgrendelt sterke redeneringen en gerichte RL controleert breedsprakigheid.

Het recept is eenvoudig en biedt een interessant datapunt voor niet-Qwen-gebaseerde modellen. Dit is nog steeds gebaseerd op onze eerste generatie LFM's - enthousiast over de volgende generatie!

Details vind je in onze blogpost!

@LiquidAI_

4,19K

Boven

Positie

Favorieten