Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

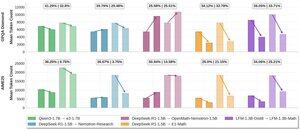

Cieszymy się, że możemy podzielić się spostrzeżeniami na temat naszej pracy nad efektywnym rozumowaniem @LiquidAI_ :

Przekształcamy ogólny model czatu 1.3B w silne rozumowanie matematyczne, które pozostaje zwięzłe. SFT na wyselekcjonowanych śladach CoT odblokowuje silne rozumowanie, a ukierunkowany RL kontroluje szczegółowość.

Przepis jest prosty i stanowi interesujący punkt danych dla modeli innych niż Qwen. Jest to nadal oparte na naszej pierwszej generacji LFM - podekscytowany następną generacją!

Szczegóły znajdziesz w naszym wpisie na blogu!

@LiquidAI_

4,18K

Najlepsze

Ranking

Ulubione