Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Alibaba heeft Qwen3 Next 80B uitgebracht: een hybride redeneermodel met open gewichten dat een intelligentie-niveau bereikt van DeepSeek V3.1 met slechts 3B actieve parameters

Belangrijkste punten:

💡 Nieuwe architectuur: Het eerste model dat de ‘Qwen3-Next’ fundamentmodellen van @Alibaba_Qwen introduceert, met verschillende belangrijke architectuurkeuzes zoals een hybride aandachtmechanisme van Gated DeltaNet en Gated Attention, en hoge spaarzaamheid met een aandeel van 3,8% actieve parameters, vergeleken met 9,4% voor Qwen3 235B

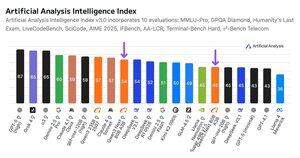

🧠 Intelligentie: Qwen3 Next 80B (Redeneren) scoort 54 op de Artificial Analysis Intelligence Index, geplaatst naast DeepSeek V3.1 (Redeneren). De niet-rederende variant scoort 45, in lijn met gpt-oss-20B en Llama Nemotron Super 49B v1.5 (Redeneren)

💲 Prijsmodel: Per token-prijs op @alibaba_cloud is $0,5/$6 per 1M invoer/uitvoer tokens voor redeneren en $0,5/$2 voor de niet-rederende variant. Dit vergeleken met hogere prijzen voor Qwen3 235B 2507 van $0,7/$8,4 met redeneren en $0,7/$2,8 zonder - een ≥25% vermindering afhankelijk van de werklasten

⚙️ Modelgegevens: Het model heeft een native contextvenster van 256k tokens en is alleen tekst, zonder multimodale invoer of uitvoer. Met slechts 80B parameters bij FP8 past het model op een enkele H200 GPU

Boven

Positie

Favorieten