Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

¿Qué se necesita para que una computadora aprenda las reglas de emparejamiento de bases de ARN?

Las personas están entrenando grandes modelos de lenguaje para la predicción de estructuras de ARN. Algunos de estos modelos tienen cientos de millones de parámetros.

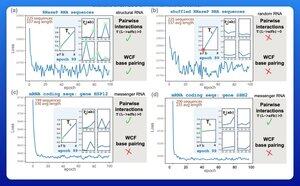

Un resultado temprano emocionante ha sido que estos modelos aprenden las reglas de emparejamiento de bases de Watson-Crick-Franklin directamente de los datos.

Un grupo de investigación en Harvard decidió ver cuál era el modelo más pequeño que podía lograr este resultado.

Entrenaron un pequeño modelo probabilístico con solo 21 parámetros utilizando descenso de gradiente.

Con tan solo 50 secuencias de ARN—sin estructuras correspondientes—las reglas de emparejamiento de bases emergían después de solo unas pocas épocas de entrenamiento.

Así que la respuesta a su pregunta original fue que se necesita "mucho menos de lo que podrías pensar" para aprender este tipo de modelo.

No creo que esto signifique que los esfuerzos de entrenamiento a gran escala sean necesariamente tontos o mal guiados. Pero este resultado sugiere que hay mucha eficiencia y rendimiento que aún se puede extraer de la innovación arquitectónica.

Hay mucha estructura subyacente en el lenguaje de la biología.

3,49K

Parte superior

Clasificación

Favoritos