トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

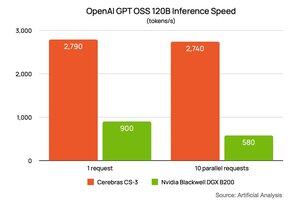

今週初め、@NVIDIA DGX B200 (8 つの 2 ダイ ブラックウェル チップ) で動作する @OpenAI の gpt-oss-120B モデルのパフォーマンスを共有しました。 彼らは@ArtificialAnlys分析に特別なセットアップを行うよう依頼しました。1 ユーザーで 900 トークン/秒のパフォーマンスを示し、10 ユーザーで 580 トークン/秒に低下しました。以下のコメントにリンクを貼り付けました。

私たちは、Artificial Analysisに同じセットアップを実行するように依頼しました。結果は、1 人で ~2700 トークン/秒となり、10 ユーザーでも同じです。@CerebrasSystems Inference は最速であるだけでなく、ワークロードをスケールアップしてもパフォーマンスを維持します。 Cerebras Inference は現在フル稼働しており、@OpenRouterAI、@huggingface、Cerebras Cloud で毎週数十億の GPT 120B トークンを提供しています。

80.13K

トップ

ランキング

お気に入り