Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Liron Shapira

Host of Doom Debates: disaccordi che devono essere risolti prima della fine del mondo.

Potresti *pensare* che questo dimostri senza dubbio l'esistenza di un'alta intelligenza generale, ma in realtà mostra solo che è possibile apprendere una combinazione specifica di abilità dalla cultura che ti circonda. I dati di addestramento giusti ti permettono di abbinare i modelli al prossimo passo nella costruzione di una cleanroom.

Matthew Hartensveld, PhD19 ore fa

Shed Cleanroom Classe 100 che ho costruito per R&D nei semiconduttori :)

1,41K

📢 NUOVE DEBATTITI SUL DOOM ESCLUSIVI: Un'intervista con Rob Miles (@robertskmiles), il più popolare educatore sulla sicurezza dell'IA su YouTube!

Incredibilmente, Rob ha iniziato nel 2011, molto prima che ChatGPT portasse l'attenzione mainstream su questo campo. Parliamo di:

👉 Perché la sua P(Doom) si colloca tra il 10% e il 90%, a seconda di come l'umanità risponde alla sfida

👉 Perché anche i sistemi di IA perfettamente allineati potrebbero non trasferire i loro valori ai sistemi successori - un enorme punto cieco nel lavoro attuale sulla sicurezza

👉 Il problema del "mood mancante": perché le persone discutono della potenziale estinzione umana con l'urgenza emotiva di una conferenza accademica invece di trattarlo come l'emergenza che è

👉 Il suo scenario principale di doom attraverso il miglioramento ricorsivo, e perché c'è un'enorme possibilità di superare l'intelligenza umana

👉 Se gli esseri umani siano la "specie meno intelligente capace di una civiltà tecnologica" - e cosa significhi per ciò che i sistemi più intelligenti potrebbero raggiungere

👉 Il nostro principale disaccordo: Rob pensa che le persone della sicurezza dovrebbero lavorare all'interno delle aziende di IA per ridurre i danni, mentre io sostengo che questo consente il "tractability-washing" che legittima imprese fondamentalmente spericolate

👉 Strategia di comunicazione - Rob si chiede se il suo approccio britannico misurato stia mancando di qualcosa di cruciale, e forse qualcuno ha bisogno di "correre urlando" per trasmettere l'urgenza appropriata

Rob ha passato oltre un decennio cercando di svegliare le persone sulla sfida più importante per l'umanità. La nostra conversazione rivela la tensione tra analisi ragionata ed emergenza esistenziale. Altamente raccomandato!

13,47K

Com'era così accurata Idiocracy?

Elon Musk21 ago, 20:53

Ani va bene 👌

6,26K

Liron Shapira ha ripubblicato

C'è una cosa divertente per cui l'educazione economica paradossalmente rende le persone più STUPIDE nel pensare al futuro dell'IA. I libri di testo di economia insegnano concetti e quadri che sono ottimi per la maggior parte delle cose, ma controproducenti per pensare all'AGI. Ecco 4 esempi. Post lungo:

IL PRIMO PEZZO di anti-pedagogia economica si nasconde nelle parole “lavoro” e “capitale”. Queste parole confondono una differenza superficiale (essere umano in carne e ossa vs non) con un insieme di assunzioni e intuizioni non espresse, che verranno tutte infrante dall'Intelligenza Artificiale Generale (AGI).

Con “AGI” intendo qui “un insieme di chip, algoritmi, elettricità e/o robot teleoperati che possono autonomamente fare le cose che gli ambiziosi adulti umani possono fare: fondare e gestire nuove aziende, R&S, apprendere nuove competenze, utilizzare robot teleoperati arbitrari dopo pochissima pratica, ecc.”

Sì, lo so, questo non esiste ancora! (Nonostante l'hype contrario.) Prova a chiedere a un LLM di scrivere autonomamente un piano aziendale, fondare un'azienda e poi gestirla e farla crescere per anni come CEO. Lol! Fallirà miseramente! Ma questa è una limitazione degli LLM di oggi, non di “tutta l'IA per sempre”. L'IA che potrebbe svolgere quel compito, e molto di più, è ovviamente possibile: i cervelli, i corpi e le società umane non sono alimentati da qualche magia per sempre al di là della portata della scienza. Io, per esempio, mi aspetto un'IA del genere nella mia vita, per il meglio o per il peggio. (Probabilmente “peggio”, vedi sotto.)

Ora, questo tipo di AGI è “lavoro” o “capitale”? Beh, non è un essere umano in carne e ossa. Ma è più simile a “lavoro” che a “capitale” in molti altri aspetti:

• Il capitale non può semplicemente alzarsi e fare cose da solo? L'AGI può.

• Le nuove tecnologie richiedono molto tempo per integrarsi nell'economia? Bene, chiediti: come fanno gli esseri umani immigrati altamente qualificati, esperti e imprenditoriali a integrarsi immediatamente nell'economia? Una volta che hai risposto a questa domanda, nota che anche l'AGI sarà in grado di fare quelle cose.

• Il capitale rimane inattivo se non ci sono umani disposti e in grado di usarlo? Beh, quegli esseri umani immigrati non rimangono inattivi. E nemmeno l'AGI.

• Il capitale non può difendere diritti politici o lanciare colpi di stato? Beh…

Comunque, la gente vede film di robot di fantascienza e lo capisce! Poi seguono corsi di economia e questo li rende più stupidi.

(Sì, lo so, #NotAllEconomists ecc.)

IL SECONDO PEZZO di anti-pedagogia economica è instillare un'assunzione predefinita che sia possibile per un mercato equilibrarsi. Ma il mercato per l'AGI non può: l'AGI combina una proprietà dei mercati del lavoro con una proprietà dei mercati dei prodotti, dove quelle proprietà sono mutuamente esclusive. Quelle proprietà sono:

• (A) “NESSUN MONTANTE DI LAVORO”: Se la popolazione umana aumenta, i salari scendono nel brevissimo termine, perché la curva della domanda di lavoro scende. Ma nel lungo termine, le persone trovano nuove cose produttive da fare: la curva della domanda si sposta a destra. Se c'è qualcosa, il valore del lavoro aumenta, non diminuisce, con la popolazione! Ad esempio, le città dense sono motori di crescita!

• (B) “CURVE D'ESPERIENZA”: Se la domanda per un prodotto aumenta, c'è un aumento di prezzo nel brevissimo termine, perché la curva dell'offerta sale. Ma nel lungo termine, le persone aumentano la produzione: la curva dell'offerta si sposta a destra. Se c'è qualcosa, il prezzo scende, non sale, con la domanda, grazie alle economie di scala e alla R&S.

QUIZ: Considerando (A) e (B), qual è il prezzo di equilibrio di questo pacchetto di AGI (chip, algoritmi, elettricità, robot teleoperati, ecc.)?

…Domanda trabocchetto! Non c'è equilibrio. I nostri due principi, (A) “nessun montante di lavoro” e (B) “curve d'esperienza”, rendono impossibile l'equilibrio:

• Se il prezzo è basso, (A) dice che la curva della domanda corre verso destra: non c'è montante di lavoro, quindi ci sono enormi profitti da realizzare da parte di AGI imprenditoriali e qualificati che trovano nuove cose produttive da fare.

• Se il prezzo è alto, (B) dice che la curva dell'offerta corre verso destra: ci sono enormi profitti da realizzare aumentando la produzione di AGI.

• Se il prezzo è nel mezzo, allora la curva della domanda e la curva dell'offerta stanno ENTRAMBE correndo verso destra!

Questo non è né capitale né lavoro come lo conosciamo. Invece di un mercato per l'AGI che si equilibra, si forma un ciclo di feedback positivo / macchina a moto perpetuo che esplode esponenzialmente.

Sembra assurdo? C'è un precedente: gli esseri umani! Il mondo umano, nel suo insieme, è già un ciclo di feedback positivo / macchina a moto perpetuo di questo tipo! Gli esseri umani si sono auto-alimentati da poche migliaia di ominidi a 8 miliardi di persone che gestiscono un'economia da 80 trilioni di dollari.

Come? Non è letteralmente una macchina a moto perpetuo. Piuttosto, è un motore che attinge dal pozzo delle “opportunità economiche non ancora sfruttate”. Ma ricorda “Nessun Montante di Lavoro”: il pozzo delle opportunità economiche non ancora sfruttate è ~infinitamente profondo. Non siamo rimasti senza possibili aziende da fondare. Nessuno ha ancora creato uno sciame di Dyson.

Ci sono solo così tanti umani per fondare aziende e sfruttare nuove opportunità. Ma il ciclo di feedback positivo dell'AGI non ha tale limite. Il tempo di raddoppio può essere davvero breve:

Immagina una fabbrica autonoma che può costruire una fabbrica autonoma identica, che poi costruisce due fabbriche in più, ecc., utilizzando solo materiali di input ampiamente disponibili e luce solare. I libri di testo di economia non parlano di questo. Ma i libri di testo di biologia sì! Un cianobatterio è una di queste fabbriche e può raddoppiarsi in un giorno (≈ tasso di crescita annualizzato di googol percentuale 😛).

Comunque, non sappiamo quanto esplosivo sarà il ciclo di feedback positivo dell'AGI che costruisce AGI, ma mi aspetto che sia anni luce oltre qualsiasi cosa nella storia economica.

IL TERZO PEZZO di anti-pedagogia economica è la sua promozione della crescita del PIL come proxy per progresso e cambiamento. Al contrario, è possibile che il mondo si trasformi in una terra di fantascienza selvaggia oltre ogni riconoscimento o comprensione ogni mese, mese dopo mese, senza che la “crescita del PIL” sia effettivamente così alta. Il PIL è una metrica divertente, e particolarmente scadente nel descrivere l'impatto delle rivoluzioni tecnologiche trasformative. (Ad esempio, se una nuova tecnologia è poco costosa, e nel frattempo altri settori dell'economia rimangono costosi a causa di restrizioni normative, allora la nuova tecnologia potrebbe non impattare molto sul PIL, indipendentemente da quanto sconvolga il mondo.) Voglio dire, certo possiamo discutere del PIL, ma non dovremmo trattarlo come una battaglia proxy su se l'AGI sarà o meno un grande affare.

Ultimo e più importante, IL QUARTO PEZZO di anti-pedagogia economica è il focus su “scambi reciprocamente vantaggiosi” rispetto a “uccidere persone e prendere le loro cose”. L'economia 101 dimostra che il commercio è egoisticamente migliore dell'isolamento. Ma a volte “uccidere persone e prendere le loro cose” è egoisticamente il migliore di tutti.

Quando parliamo di AGI, stiamo parlando di creare una nuova specie intelligente sulla Terra, una che sarà alla fine più veloce, più intelligente, meglio coordinata e più numerosa degli esseri umani.

Le persone normali, persone che hanno visto film di fantascienza su robot e alieni, persone che hanno appreso la storia del colonialismo e della schiavitù, faranno immediatamente molte domande ragionevoli qui. “Quali saranno le loro motivazioni?” “Chi avrà il potere duro?” “Se sembrano amichevoli e cooperativi all'inizio, potrebbero pugnalarci alle spalle quando diventano più potenti?”

Queste sono domande eccellenti! Dobbiamo assolutamente porre queste domande! (Per quanto mi riguarda, questo è il mio campo di competenza, e sono molto pessimista.)

…E poi quelle persone normali seguono corsi di economia e finiscono per diventare più stupide. Smettono di porre quelle domande. Invece, “imparano” che l'AGI è “capitale”, un po' come una macchina per stampaggio ad iniezione. Le macchine per stampaggio ad iniezione non sterminerebbero gli esseri umani e non gestirebbero il mondo da sole. Quindi stiamo bene. Lol.

39,16K

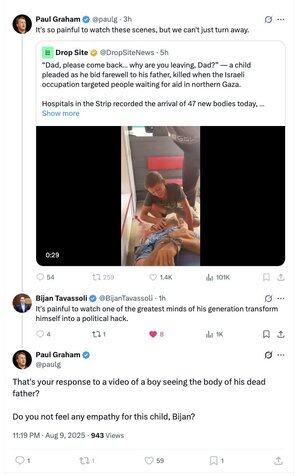

.@paulg deve essere un fan di Ms. Rachel.

Entrambi usano lo stesso trucco evasivo: trattare i due nodi (azione israeliana)→(vittima civile) come l'intero contesto causale su cui esprimere un'opinione.

D: Dovrebbero essere consentiti gli scudi umani?

R: La vita di ogni non combattente vale la stessa 🧘

Liron Shapira10 ago, 16:33

Ciao @paulg, la tua partecipazione a questo discorso continua a essere frustrantemente improduttiva.

"Non senti empatia???" è la stessa cosa che entrambe le parti stanno dicendo. Ogni israeliano è stato vittima di crimini di guerra oggi, con i nostri ostaggi scheletrici ancora affamati per un altro giorno. Non *senti* alcuna empatia??? Va bene, allora entrambi sentiamo empatia.

L'empatia, contrariamente a quello che sembri implicare nei tuoi tweet continui, non implica che un particolare piano per Israele di difendere la sua sovranità contro il nemico ancora determinato sia migliore di un altro. Non c'è una semplice opzione "smetti di causare morte". Hamas ha fatto pesanti richieste per un cessate il fuoco.

Per favore, dicci qual è il tuo obiettivo. Sai che "prevenire la morte" non è una risposta chiarificatrice sulla tua posizione. Bisogna ampliare il proprio contesto e districarsi nella rete causale più ampia per dare una risposta.

Vuoi che il controllo ebraico sovrano su Israele finisca? Preferiresti lasciare che gli islamisti "ritornino" liberamente?

Non sto mettendo parole in bocca, non ti sto chiamando antisemita. Sto solo chiedendo che, per il bene di un discorso di qualità, ci dia più contesto sui tuoi risultati desiderati invece di giocare solo una parte di una carta empatica simmetrica.

3,87K

Principali

Ranking

Preferiti

On-chain di tendenza

Di tendenza su X

Principali fondi recenti

Più popolari