Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Liron Shapira

Multitud de debates de Doom: desacuerdos que deben resolverse antes de que se acabe el mundo.

Puedes *pensar* que esto prueba más allá de toda duda la existencia de una alta inteligencia general, pero en realidad solo muestra que es posible aprender una combinación específica de habilidades de la cultura que te rodea. Los datos de entrenamiento adecuados te permiten hacer coincidir patrones con el siguiente paso en la construcción de salas limpias.

Matthew Hartensveld, PhDHace 17 horas

Shed de sala limpia Clase 100 que construí para I+D de semiconductores :)

1,29K

📢 NUEVAS DEBATES SOBRE EL DOOM EXCLUSIVO: ¡Una entrevista con Rob Miles (@robertskmiles), el educador de seguridad de IA más popular en YouTube!

Increíblemente, Rob comenzó en 2011, mucho antes de que ChatGPT atrajera la atención del público hacia el campo. Hablamos sobre:

👉 Por qué su P(Doom) se sitúa entre el 10-90%, dependiendo de cómo la humanidad responda al desafío

👉 Por qué incluso los sistemas de IA perfectamente alineados podrían no transmitir sus valores a los sistemas sucesores - un enorme punto ciego en el trabajo de seguridad actual

👉 El problema de "humor ausente": por qué las personas discuten la posible extinción humana con la urgencia emocional de una conferencia académica en lugar de tratarlo como la emergencia que es

👉 Su escenario principal de doom a través de la auto-mejora recursiva, y por qué hay un enorme margen por encima de la inteligencia humana

👉 Si los humanos son la "especie menos inteligente capaz de una civilización tecnológica" - y lo que eso significa para lo que los sistemas más inteligentes podrían lograr

👉 Nuestro desacuerdo clave: Rob piensa que las personas de seguridad deberían trabajar dentro de las empresas de IA para la reducción de daños, mientras que yo argumento que esto habilita el "lavado de tractabilidad" que legitima empresas fundamentalmente imprudentes

👉 Estrategia de comunicación - Rob se pregunta si su enfoque británico medido está perdiendo algo crucial, y tal vez alguien necesita estar "corriendo y gritando" para transmitir la urgencia adecuada

Rob ha pasado más de una década tratando de despertar a las personas sobre el desafío más importante de la humanidad. Nuestra conversación revela la tensión entre el análisis razonado y la emergencia existencial. ¡Altamente recomendado!

12,68K

¿Cómo fue tan precisa Idiocracia?

Elon Musk21 ago, 20:53

Ani está bien 👌

6,23K

Liron Shapira republicó

Hay una cosa curiosa donde la educación económica, paradójicamente, hace que las personas sean MÁS TORPES al pensar sobre la futura IA. Los libros de texto de economía enseñan conceptos y marcos que son excelentes para la mayoría de las cosas, pero contraproducentes para pensar sobre la AGI. Aquí hay 4 ejemplos. Publicación larga:

LA PRIMERA PIEZA de la anti-pedagogía económica se esconde en las palabras "trabajo" y "capital". Estas palabras confunden una diferencia superficial (humano de carne y hueso vs no) con un conjunto de suposiciones e intuiciones no expresadas, que serán todas destruidas por la Inteligencia General Artificial (AGI).

Por "AGI" me refiero aquí a "un conjunto de chips, algoritmos, electricidad y/o robots teleoperados que pueden hacer de forma autónoma los tipos de cosas que los adultos humanos ambiciosos pueden hacer: fundar y dirigir nuevas empresas, I+D, aprender nuevas habilidades, usar robots teleoperados arbitrarios después de muy poca práctica, etc."

¡Sí, lo sé, esto aún no existe! (A pesar del bombo en contrario). Intenta pedirle a un LLM que escriba de forma autónoma un plan de negocios, funde una empresa y luego la dirija y haga crecer durante años como CEO. ¡Lol! ¡Se estrellará y quemará! Pero esa es una limitación de los LLM de hoy, no de "toda IA para siempre". La IA que podría realizar esa tarea, y mucho más allá, es obviamente posible: los cerebros, cuerpos y sociedades humanas no están impulsados por alguna magia que esté eternamente más allá del alcance de la ciencia. Por mi parte, espero tal IA en mi vida, para bien o para mal. (Probablemente "para mal", ver más abajo).

Ahora, ¿es este tipo de AGI "trabajo" o "capital"? Bueno, no es un humano de carne y hueso. Pero es más como "trabajo" que "capital" en muchos otros aspectos:

• ¿El capital no puede simplemente levantarse y hacer cosas por sí mismo? La AGI puede.

• ¿Las nuevas tecnologías tardan mucho en integrarse en la economía? Bueno, pregúntate: ¿cómo logran integrarse inmediatamente los humanos inmigrantes altamente calificados, experimentados y emprendedores en la economía? Una vez que hayas respondido a esa pregunta, ten en cuenta que la AGI también podrá hacer esas cosas.

• ¿El capital permanece inactivo si no hay humanos dispuestos y capaces de usarlo? Bueno, esos humanos inmigrantes no permanecen inactivos. Y la AGI tampoco lo hará.

• ¿El capital no puede abogar por derechos políticos, o lanzar golpes? Bueno...

De todos modos, la gente ve películas de robots de ciencia ficción, ¡y lo entienden! Luego toman cursos de economía, y eso los hace más tontos.

(Sí, lo sé, #NoTodosLosEconomistas, etc.)

LA SEGUNDA PIEZA de la anti-pedagogía económica es inculcar una suposición predeterminada de que es posible que un mercado se equilibre. Pero el mercado de la AGI no puede: la AGI combina una propiedad de los mercados laborales con una propiedad de los mercados de productos, donde esas propiedades son mutuamente excluyentes. Esas propiedades son:

• (A) "NO HAY UN LOTE DE TRABAJO": Si la población humana aumenta, los salarios caen en el muy corto plazo, porque la curva de demanda de trabajo tiene pendiente negativa. Pero a largo plazo, las personas encuentran nuevas cosas productivas que hacer: la curva de demanda se desplaza a la derecha. Si acaso, ¡el valor del trabajo aumenta, no disminuye, con la población! Por ejemplo, ¡las ciudades densas son motores de crecimiento!

• (B) "CURVAS DE EXPERIENCIA": Si la demanda de un producto aumenta, hay un aumento de precio en el muy corto plazo, porque la curva de oferta tiene pendiente positiva. Pero a largo plazo, las personas aumentan la fabricación: la curva de oferta se desplaza a la derecha. Si acaso, ¡el precio baja, no sube, con la demanda, gracias a las economías de escala y la I+D!

QUIZ: Considerando (A) y (B), ¿cuál es el precio de equilibrio de este conjunto de AGI (chips, algoritmos, electricidad, robots teleoperados, etc.)?

...¡Pregunta trampa! No hay equilibrio. Nuestros dos principios, (A) "no hay un lote de trabajo" y (B) "curvas de experiencia", hacen que el equilibrio sea imposible:

• Si el precio es bajo, (A) dice que la curva de demanda se desplaza rápidamente hacia la derecha: no hay un lote de trabajo, por lo tanto, hay enormes beneficios que obtener de AGIs emprendedores y calificados encontrando nuevas cosas productivas que hacer.

• Si el precio es alto, (B) dice que la curva de oferta se desplaza rápidamente hacia la derecha: hay enormes beneficios que obtener al aumentar la fabricación de AGI.

• Si el precio está en medio, entonces la curva de demanda y la curva de oferta se desplazan AMBAS rápidamente hacia la derecha.

Esto no es ni capital ni trabajo como lo conocemos. En lugar de que el mercado de AGI se equilibre, forma un bucle de retroalimentación positiva / máquina de movimiento perpetuo que explota exponencialmente.

¿Suena absurdo? Hay un precedente: ¡los humanos! El mundo humano, en su conjunto, ya es un bucle de retroalimentación positiva / máquina de movimiento perpetuo de este tipo. Los humanos se impulsaron desde unos pocos miles de homínidos hasta 8 mil millones de personas que manejan una economía de 80 billones de dólares.

¿Cómo? No es literalmente una máquina de movimiento perpetuo. Más bien, es un motor que extrae del pozo de "oportunidades económicas aún no explotadas". Pero recuerda "No hay un lote de trabajo": el pozo de oportunidades económicas aún no explotadas es ~infinitamente profundo. No nos hemos quedado sin posibles empresas que fundar. Nadie ha hecho aún un enjambre de Dyson.

Solo hay tantos humanos para fundar empresas y explotar nuevas oportunidades. Pero el bucle de retroalimentación positiva de la AGI no tiene tal límite. El tiempo de duplicación puede ser muy corto:

Imagina una fábrica autónoma que puede construir una fábrica autónoma idéntica, que luego construye dos más, etc., utilizando solo materiales de entrada ampliamente disponibles y luz solar. Los libros de texto de economía no hablan de eso. ¡Pero los libros de biología sí! Una cianobacteria es tal fábrica, y puede duplicarse en un día (≈ tasa de crecimiento anualizada de googol por ciento 😛).

De todos modos, no sabemos cuán explosivo será el bucle de retroalimentación positiva de la AGI construyendo AGI, pero espero que esté a años luz de cualquier cosa en la historia económica.

LA TERCERA PIEZA de la anti-pedagogía económica es su promoción del crecimiento del PIB como un proxy para el progreso y el cambio. Por el contrario, es posible que el mundo se transforme en una tierra salvaje de ciencia ficción más allá de todo reconocimiento o comprensión cada mes, mes tras mes, sin que el "crecimiento del PIB" sea realmente tan alto. El PIB es una métrica curiosa, y especialmente mala para describir el impacto de revoluciones tecnológicas transformadoras. (Por ejemplo, si alguna nueva tecnología es económica, y mientras tanto otros sectores de la economía permanecen caros debido a restricciones regulatorias, entonces la nueva tecnología podría no impactar mucho el PIB, sin importar cuánto altere el mundo). Quiero decir, claro que podemos discutir sobre el PIB, pero no deberíamos tratarlo como una batalla proxy sobre si la AGI será o no un gran problema.

Por último y más importante, LA CUARTA PIEZA de la anti-pedagogía económica es el enfoque en "intercambios mutuamente beneficiosos" sobre "matar personas y llevarse sus cosas". La economía 101 demuestra que comerciar es egoístamente mejor que el aislamiento. Pero a veces "matar personas y llevarse sus cosas" es egoístamente lo mejor de todo.

Cuando hablamos de AGI, estamos hablando de crear una nueva especie inteligente en la Tierra, una que eventualmente será más rápida, más inteligente, mejor coordinada y más numerosa que los humanos.

Las personas normales, personas que han visto películas de ciencia ficción sobre robots y extraterrestres, personas que han aprendido la historia del colonialismo y la esclavitud, inmediatamente harán muchas preguntas razonables aquí. "¿Cuáles serán sus motivos?" "¿Quién tendrá el poder duro?" "Si parecen amigables y cooperativos al principio, ¿podrían apuñalarnos por la espalda cuando se vuelvan más poderosos?"

¡Estas son preguntas excelentes! ¡Definitivamente deberíamos estar haciendo estas preguntas! (Para que conste, esta es mi área de especialización, y soy muy pesimista).

...Y luego esas personas normales toman clases de economía, y terminan más estúpidas. Dejan de hacer esas preguntas. En cambio, "aprenden" que la AGI es "capital", algo así como una máquina de moldeo por inyección. Las máquinas de moldeo por inyección no acabarían con los humanos y no dirigirían el mundo por sí solas. Así que estamos bien. Lol.

39,16K

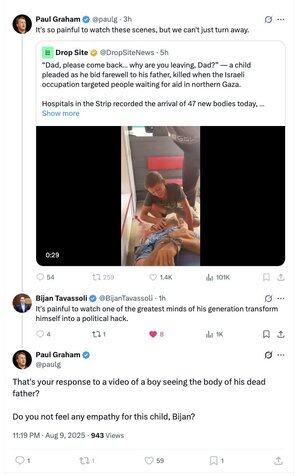

.@paulg debe ser fan de la Sra. Rachel.

Ambos utilizan el mismo truco evasivo: tratar los dos nodos (acción israelí)→(baja civil) como todo el contexto causal sobre el cual opinar.

P: ¿Deberían permitirse los escudos humanos?

R: La vida de cada no combatiente vale lo mismo 🧘

Liron Shapira10 ago, 16:33

Hola @paulg, tu participación en este discurso sigue siendo frustrantemente improductiva.

"¿No sientes empatía???" es lo mismo que ambas partes están diciendo. Cada israelí también ha sido víctima de crímenes de guerra hoy, con nuestros escuálidos rehenes aún siendo sometidos a hambre un día más. ¿Tú *no* sientes ninguna empatía??? Bien, entonces ambos sentimos empatía.

La empatía, contrariamente a lo que pareces estar insinuando en tus tweets continuos, no implica que un plan particular para que Israel defienda su soberanía contra el enemigo aún decidido sea mejor que otro. No hay una simple opción de "simplemente deja de causar muertes". Hamas hizo demandas severas para un alto el fuego.

Por favor, solo dinos cuál es tu objetivo. Sabes que "prevenir muertes" no es una respuesta aclaratoria sobre tu posición. Uno tiene que ampliar su contexto y lidiar con la red causal más grande para dar una respuesta.

¿Quieres que el control judío soberano sobre Israel termine? ¿Preferirías dejar que los islamistas "regresen" libremente a él?

No estoy poniendo palabras en tu boca, ni te estoy llamando antisemita. Solo solicito que, por el bien de un discurso de calidad, nos des más contexto sobre tus resultados deseados en lugar de simplemente jugar un lado de una carta de empatía simétrica.

3,85K

Parte superior

Clasificación

Favoritos

En tendencia on-chain

En tendencia en X

Principales fondos recientes

Más destacado