热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

Liron Shapira

Host of Doom Debates — 必须在世界末日之前解决的分歧。

📢 新的 DOOM 辩论独家:与 Rob Miles (@robertskmiles) 的采访,他是 YouTube 上最受欢迎的 AI 安全教育者!

令人惊讶的是,Rob 在 2011 年就开始了他的事业,远在 ChatGPT 将这一领域带入主流关注之前。我们讨论了:

👉 为什么他的 P(Doom) 在 10-90% 之间,具体取决于人类如何应对这一挑战

👉 为什么即使是完全对齐的 AI 系统也可能无法将其价值观传递给后继系统——这是当前安全工作中的一个巨大盲点

👉 "缺失的情绪" 问题:为什么人们以学术会议的情感紧迫感讨论潜在的人类灭绝,而不是将其视为紧急情况

👉 他的主流厄运情景通过递归自我改进,以及为什么人类智能之上还有巨大的提升空间

👉 人类是否是 "能够实现技术文明的最不智能物种"——这对更智能的系统可能实现的目标意味着什么

👉 我们的主要分歧:Rob 认为安全工作者应该在 AI 公司内部工作以减少危害,而我则认为这使得 "可处理性洗白" 合法化了根本上不负责任的企业

👉 沟通策略——Rob 想知道他那种谨慎的英国方式是否缺少了某些关键内容,也许有人需要 "四处奔跑尖叫" 来传达适当的紧迫感

Rob 花了十多年时间试图唤醒人们关注人类最重要的挑战。我们的对话揭示了理性分析与生存紧急之间的紧张关系。强烈推荐!

13.47K

《愚蠢的时代》是如何如此准确的

Elon Musk8月21日 20:53

Ani 没问题 👌

6.26K

Liron Shapira 已转发

有一个有趣的现象,经济学教育反而让人们在思考未来人工智能时变得更愚蠢。经济学教科书教授的概念和框架对大多数事情都很有效,但对思考通用人工智能(AGI)却适得其反。以下是四个例子。长文:

第一部分经济学反教学法隐藏在“劳动”和“资本”这两个词中。这些词将表面上的差异(有血有肉的人类与非人类)与一系列未言明的假设和直觉混为一谈,而这些假设和直觉都将被通用人工智能(AGI)打破。

在这里,我所说的“AGI”是指“一个由芯片、算法、电力和/或遥控机器人组成的系统,能够自主完成雄心勃勃的人类成年人可以做的事情——创办和运营新公司、研发、学习新技能、在几乎没有实践的情况下使用任意遥控机器人等。”

是的,我知道,这种东西现在还不存在!(尽管有相反的炒作。)试着让一个大型语言模型(LLM)自主撰写商业计划,创办一家公司,然后作为首席执行官运营和发展多年。哈哈!它会崩溃的!但这只是今天的LLM的局限,而不是“所有AI永远”的局限。能够完成这个任务的AI,以及更多其他任务,显然是可能的——人类的大脑、身体和社会并不是由某种神奇的魔法驱动,永远超出科学的触及。我个人期待在我的一生中看到这样的AI,无论是好是坏。(可能是“坏”,见下文。)

那么,这种AGI是“劳动”还是“资本”?它不是有血有肉的人类。但在许多其他方面,它更像是“劳动”而不是“资本”:

• 资本不能自己随便做事情?AGI可以。

• 新技术需要很长时间才能融入经济?那么问问自己:那些高技能、有经验和有创业精神的移民人类是如何立即融入经济的?一旦你回答了这个问题,请注意AGI也能够做到这些。

• 如果没有人类愿意和能够使用它,资本就会闲置?那么那些移民人类可不会闲着。AGI也不会。

• 资本不能倡导政治权利,或发动政变?那么……

无论如何,人们看到科幻机器人电影,他们就明白了!然后他们上经济学课程,这让他们变得更愚蠢。

(是的,我知道,#并非所有经济学家等。)

第二部分经济学反教学法是灌输一种默认假设,即市场可以达到均衡。但AGI的市场无法达到均衡:AGI结合了劳动市场的一个特性和产品市场的一个特性,而这些特性是相互排斥的。这些特性是:

• (A) “没有劳动总量”:如果人类人口增加,工资在短期内会下降,因为劳动的需求曲线向下倾斜。但在长期内,人们会找到新的生产性工作——需求曲线向右移动。如果有什么的话,随着人口的增加,劳动的价值会上升,而不是下降!例如,密集的城市是增长的引擎!

• (B) “经验曲线”:如果对某种产品的需求上升,短期内价格会上涨,因为供应曲线向上倾斜。但在长期内,人们会增加生产——供应曲线向右移动。如果有什么的话,随着需求的增加,价格会下降,而不是上升,这要归功于规模经济和研发。

测验:考虑(A)和(B),这个AGI组合(芯片、算法、电力、遥控机器人等)的均衡价格是多少?

……这是个陷阱问题!没有均衡。我们的两个原则,(A) “没有劳动总量”和(B) “经验曲线”,使得均衡变得不可能:

• 如果价格低,(A)说需求曲线向右急剧上升——没有劳动总量,因此有大量的利润可以通过熟练的创业AGI找到新的生产性工作来获得。

• 如果价格高,(B)说供应曲线向右急剧上升——有大量的利润可以通过增加AGI的生产来获得。

• 如果价格在中间,那么需求曲线和供应曲线都在向右急剧上升!

这既不是我们所知的资本,也不是劳动。AGI的市场不是达到均衡,而是形成一个正反馈循环/永动机,呈指数级增长。

这听起来荒谬吗?有先例:人类!人类世界作为一个整体,已经是这种类型的正反馈循环/永动机!人类从几千个古人类自我提升到80亿人,运营着一个80万亿美元的经济。

怎么做到的?这并不是真正的永动机。相反,它是一个从“尚未开发的经济机会”中汲取动力的引擎。但请记住“没有劳动总量”:尚未开发的经济机会的井是~无限深的。我们还没有用尽可以创办的公司。没有人做过戴森群。

创办公司和开发新机会的人类数量是有限的。但AGI的正反馈循环没有这样的限制。翻倍的时间确实可以很短:

想象一个能够建造一个相同的自主工厂的自主工厂,然后再建造两个,等等,使用的只是广泛可用的原材料和阳光。经济学教科书不谈这个。但生物学教科书会谈!蓝藻就是这样的工厂,可以在一天内自我翻倍(≈谷歌百分比年化增长率😛)。

无论如何,我们不知道AGI构建AGI的正反馈循环会有多爆炸性,但我预计它将远远超出经济历史上的任何东西。

第三部分经济学反教学法是其将GDP增长作为进步和变化的代理。相反,世界可以每个月转变为一个超乎想象的科幻世界,月复一月,而“GDP增长”实际上并没有那么高。GDP是一个有趣的指标,尤其在描述变革性技术革命的影响时表现不佳。(例如,如果某些新技术便宜,而与此同时经济的其他部门由于监管限制仍然昂贵,那么新技术可能对GDP的影响不大,无论它如何颠覆世界。)我的意思是,当然我们可以争论GDP,但我们不应该将其视为关于AGI是否会成为大事的代理战。

最后也是最重要的,第四部分经济学反教学法是关注“互利交易”而非“杀人夺取他们的东西”。经济学101证明,交易在自私上比孤立更好。但有时“杀人夺取他们的东西”是最自私的选择。

当我们谈论AGI时,我们谈论的是在地球上创造一个新的智能物种,它最终将比人类更快、更聪明、更协调、更众多。

普通人,看到关于机器人和外星人的科幻电影的人,学习过殖民主义和奴隶制历史的人,会立即提出许多合理的问题。“他们的动机是什么?”“谁将拥有硬实力?”“如果他们一开始看起来友好和合作,当他们变得更强大时,他们会不会在背后捅我们一刀?”

这些都是很好的问题!我们绝对应该问这些问题!(顺便说一下,这是我的专业领域,我非常悲观。)

……然后那些普通人上了经济学课,结果变得更愚蠢。他们停止了问这些问题。相反,他们“学到”AGI是“资本”,有点像注塑机。注塑机不会自己消灭人类并统治世界。所以我们没事。哈哈。

39.16K

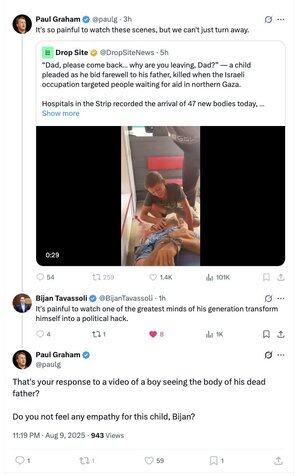

.@paulg 一定是 Ms. Rachel 的粉丝。

他们都使用同样的回避技巧:将两个节点(以色列行动)→(平民伤亡)视为可以发表意见的整个因果背景。

问:人盾应该被允许工作吗?

答:每个非战斗人员的生命都是同等重要的 🧘

Liron Shapira8月10日 16:33

嘿 @paulg,你在这个讨论中的参与继续让人感到沮丧且无效。

“你难道不感到同情吗???”是双方都在说的同样话。今天每个以色列人也都遭受了战争罪,我们的骨瘦如柴的人质又被饿了一天。你*不*感到任何同情吗??? 好吧,那么我们都感到同情。

同情,与你在持续的推文中似乎暗示的相反,并不意味着某个特定的以色列防卫主权的计划比另一个更好。没有简单的“停止造成死亡”的选项。哈马斯对停火提出了严苛的要求。

请告诉我们你的目标是什么。你知道“防止死亡”并不是一个能阐明你立场的答案。人们必须拓宽自己的视野,纠缠于更大的因果关系网中才能给出答案。

你想要以色列的犹太主权结束吗?你更愿意让伊斯兰主义者自由“返回”吗?

我不是在给你下定义,也不是在称你反犹太主义。只是请求你为了高质量的讨论,给我们更多关于你期望结果的背景,而不是仅仅在对称的同情卡上玩一方。

3.87K

热门

排行

收藏

链上热点

X 热门榜

近期融资

最受认可