Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

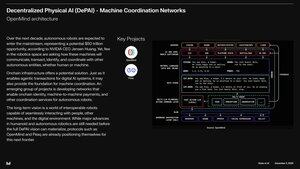

Quando Messari inserisce la tua architettura in un rapporto DePAI, non sei più "solo un altro progetto di robotica". Il modo in cui analizzano OM1 in quel documento State of AI 2025 tratta fondamentalmente @openmind_agi come il design di riferimento per robot interoperabili.

Ho esaminato la sezione DePAI su OpenMind, poi l'ho confrontata con la documentazione di OM1 + GitHub. I pezzi si allineano: l'architettura centrale di OM1 gestisce tutto attraverso un Natural Language Data Bus e un State Fuser che trasforma i feed dei sensori grezzi in un paragrafo di stato del mondo prima che qualsiasi agente decida cosa fare.

Da lì, i comportamenti non sono codificati nel firmware, ma vivono nelle configurazioni degli agenti JSON5 sotto /config/*.json5, dove mescoli input, azioni e prompt per robot. Il repository non è nemmeno un giocattolo: oltre 500 PR chiusi già su OM1 da solo.

❯ DePAI: evidenzia OM1 come un'architettura nel più ampio stack AI decentralizzato

❯ Documentazione OM1: NL Data Bus + State Fuser + pianificazione multi-LLM spiegata

❯ GitHub: runtime attivo e modulare dove chiunque può spedire nuove "abilità" per robot

Rispetto alla maggior parte dei progetti DeAI (solo calcolo o solo dati), OpenMind si trova all'incrocio: robot, agenti e infrastruttura on-chain in un unico ciclo.

Se sei un costruttore, il mio consiglio sarebbe: leggi la pagina dell'architettura di OM1, scorri la sezione DePAI, poi effettivamente fork il repository e scrivi un piccolo agente JSON5. È allora che si comprende come potrebbe apparire un sistema operativo robotico globale e interoperabile.

Principali

Ranking

Preferiti