Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

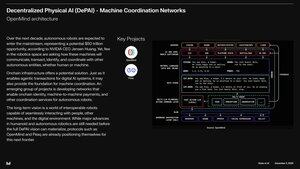

Kiedy Messari umieszcza twoją architekturę w raporcie DePAI, nie jesteś już „tylko kolejnym projektem robotycznym”. Sposób, w jaki rozkładają OM1 w tym artykule State of AI 2025, zasadniczo traktuje @openmind_agi jako wzór referencyjny dla interoperacyjnych robotów.

Przeszedłem przez sekcję DePAI na OpenMind, a następnie sprawdziłem to z dokumentacją OM1 + GitHubem. Elementy się zgadzają: rdzenna architektura OM1 przetwarza wszystko przez Natural Language Data Bus i State Fuser, który przekształca surowe dane z czujników w jeden akapit stanu świata, zanim jakikolwiek agent zdecyduje, co zrobić.

Stamtąd, zachowania nie są zakodowane w oprogramowaniu układowym, żyją w konfiguracjach agentów JSON5 pod /config/*.json5, gdzie łączysz wejścia, działania i podpowiedzi dla każdego robota. Repozytorium to nie jest zabawka: już 500+ zamkniętych PR-ów tylko w OM1.

❯ DePAI: wskazuje OM1 jako architekturę w szerszym zdecentralizowanym stosie AI

❯ Dokumentacja OM1: NL Data Bus + State Fuser + planowanie multi-LLM opisane

❯ GitHub: aktywne, modułowe środowisko uruchomieniowe, w którym każdy może dostarczyć nowe „umiejętności” robota

W porównaniu do większości projektów DeAI (tylko obliczenia lub tylko dane), OpenMind znajduje się na skrzyżowaniu: roboty, agenci i infrastruktura on-chain w jednej pętli.

Jeśli jesteś twórcą, moja sugestia to: przeczytaj stronę architektury OM1, przeskocz sekcję DePAI, a następnie faktycznie sklonuj repozytorium i napisz małego agenta JSON5. Wtedy zrozumiesz, jak mogłoby wyglądać globalne, interoperacyjne OS robota.

Najlepsze

Ranking

Ulubione