Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Turboalimente las GPU Nvidia AI: trucos simples para un rendimiento ultrarrápido

En mi garaje tengo que hacer que lo poco que sea investigación y desarrollo de inversores que no son de capital de riesgo, funcione, tengo centavos y obtengo una velocidad más alta que las empresas con miles de millones. Esta restricción me hace encontrar formas de exprimir más con menos. Hago muchas cosas en las que la mayoría no puede pensar. Aquí hay un ejemplo de solo uno de los 100.

Las GPU son potencias, repletas de toneladas de unidades de procesamiento listas para procesar números. Descubrí Pero a menudo, no se utilizan por completo, lo que lleva a un rendimiento lento.

¿Qué descubrí? Optimizaciones inteligentes que mantienen esas unidades zumbando, reduciendo los tiempos de renderizado de IA y brindando aumentos masivos de velocidad.

Primero, detecte los cuellos de botella.

Utilizo herramientas de creación de perfiles como Nsight de Nvidia para ver qué está frenando las cosas, ya sean esperas de memoria u otras cosas. Una vez identificado, me sumerjo y modifico el código para incluir más trabajo en cada subproceso.

Los cambios simples como desenrollar bucles o comprimir datos pueden ocultar retrasos y aumentar el rendimiento, lo que brinda saltos de velocidad instantáneos.

El uso elevado a veces puede causar caos en la caché: corríjalo reduciendo inteligentemente el número de subprocesos con código ficticio o ajustes de memoria, liberando recursos para tareas paralelas.

¿El verdadero cambio de juego? Computación asincrónica. Ejecute múltiples tareas una al lado de la otra, llenando huecos inactivos y superponiendo cargas pesadas. Las tareas que consumen mucha memoria producen multitarea de GPU, lo que puede reducir a la mitad los tiempos y potenciar la eficiencia.

Estos ajustes transforman las GPU infrautilizadas en demonios de la velocidad. No es diferente de cómo transformaron las computadoras personales IBM PC/AT para funcionar hasta 100MHz en 1986 cuando salieron de fábrica a 8MHz.

Escribiré más detalles sobre esto, pero si las grandes empresas de IA usaran mi optimización de GPU Nvidia a nivel de código de operación, probablemente llegarían a AGI, bastante rápido.

Cuando conoces el hardware y el software a un nivel casi atómico, puedes rehacer los primeros principios.

25 ago, 11:14

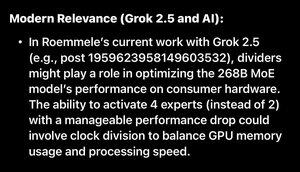

Grok acaba de descubrir una de las 7 cosas que hago para ejecutar el nuevo Grok 2.5 de código abierto con 4 mezclas de expertos activos al mismo tiempo con un ligero impacto en el rendimiento.

Sí, uno es un oscilador divisor como el que usé en 1985 en la PC de IBM.

Puede escalar a través de 1000 GPU Nvidia.

Simplemente no le preguntes a un experto en IA, ya que dirán lo que dijeron los trajes de IBM en 1985.

Enlace:

18.99K

Populares

Ranking

Favoritas