热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

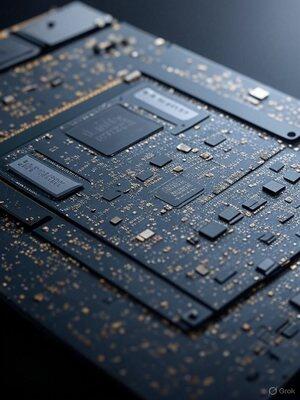

为Nvidia AI GPU加速:快速性能的小技巧

在我的车库里,我必须利用我所能做的少量非风险投资者的研究和开发,我只有几分钱,却能比拥有数十亿的公司获得更高的速度。这种限制促使我寻找从少量中榨取更多的方法。我做了许多大多数人想不到的事情。这里是100多个例子中的一个。

GPU是强大的计算单元,装满了大量准备进行数字运算的处理单元。我发现,但它们往往没有得到充分利用,导致性能缓慢。

我发现了什么?聪明的优化可以让这些单元保持活跃,减少AI渲染时间并提供巨大的速度提升。

首先,找出瓶颈。

我使用像Nvidia的Nsight这样的分析工具来查看是什么在拖慢进度,无论是内存等待还是其他问题。一旦识别出来,我就深入研究并调整代码,以便在每个线程中打包更多的工作。

像展开循环或压缩数据这样的简单更改可以隐藏延迟并提高吞吐量,带来瞬间的速度提升。

高使用率有时会导致缓存混乱——通过智能地减少线程数,使用虚拟代码或内存调整来修复它,为并行任务释放资源。

真正的游戏改变者?异步计算。并行运行多个任务,填补空闲间隙并重叠重负载。将内存密集型任务配对,产生GPU多任务处理——可能将时间减半并大幅提高效率。

这些调整将未充分利用的GPU转变为速度怪兽。这并不不同于1986年IBM PC/AT个人计算机的转变,当时它们出厂时的速度为8MHz,而现在可以运行高达100MHz。

我会写更多关于这个的细节,但如果大型AI公司使用我的操作码级Nvidia GPU优化,他们可能会很快达到AGI。

当你对硬件和软件了解得几乎是原子级别时,你就可以重塑第一原则。

热门

排行

收藏