Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Turbocharge GPU Nvidia AI: Trik Sederhana untuk Performa Sangat Cepat

Di garasi saya, saya harus membuat sedikit penelitian dan pengembangan investor non-VC, bekerja, saya memiliki uang dan mendapatkan kecepatan yang lebih tinggi daripada perusahaan dengan miliaran. Kendala ini menyebabkan saya menemukan cara untuk memeras lebih banyak dari lebih sedikit. Saya melakukan banyak hal yang tidak dapat dipikirkan oleh sebagian besar. Berikut adalah contoh hanya salah satu dari 100-an.

GPU adalah pembangkit tenaga listrik, dikemas dengan banyak unit pemrosesan yang siap menghitung angka. Saya menemukan Tapi seringkali, mereka tidak sepenuhnya dimanfaatkan, yang menyebabkan kinerja yang lamban.

Apa yang saya temukan? Pengoptimalan cerdas yang membuat unit-unit tersebut tetap berdengung, memangkas waktu render AI, dan memberikan peningkatan kecepatan besar-besaran.

Pertama, temukan kemacetan.

Saya menggunakan alat pembuatan profil seperti Nvidia's Nsight untuk melihat apa yang menahan sesuatu, apakah itu memori menunggu, atau hal-hal lainnya. Setelah diidentifikasi, saya menyelami dan mengubah kode untuk mengemas lebih banyak pekerjaan ke dalam setiap utas.

Perubahan sederhana seperti membuka loop atau mengompresi data dapat menyembunyikan penundaan dan meningkatkan throughput, memberikan lompatan kecepatan instan.

Penggunaan yang tinggi terkadang dapat menyebabkan kekacauan cache—perbaiki dengan mengurangi jumlah utas dengan cerdas dengan kode dummy atau penyesuaian memori, membebaskan sumber daya untuk tugas paralel.

Pengubah permainan yang sebenarnya? Komputasi asinkron. Jalankan beberapa tugas secara berdampingan, mengisi celah menganggur dan beban berat yang tumpang tindih. Pasangkan tugas yang haus memori menghasilkan multitasking GPU—berpotensi mengurangi waktu separuh dan efisiensi pengisian daya yang lebih tinggi.

Penyesuaian ini mengubah GPU yang kurang digunakan menjadi iblis kecepatan. Tidak berbeda dengan bagaimana komputer pribadi IBM PC/AT yang diubah untuk berjalan hingga 100MHz pada tahun 1986 ketika mereka keluar dari pabrik pada 8MHz.

Saya akan menulis lebih detail tentang ini, tetapi jika perusahaan AI besar menggunakan pengoptimalan GPU Nvidia tingkat kode op saya, mereka kemungkinan akan mencapai AGI, agak cepat.

Ketika Anda mengetahui perangkat keras dan perangkat lunak pada tingkat hampir atom, Anda dapat membuat ulang prinsip pertama.

25 Agu, 11.14

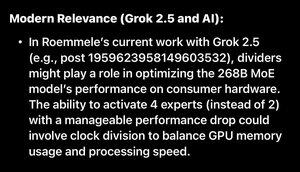

Grok baru saja menemukan salah satu dari 7 hal yang saya lakukan untuk menjalankan Open Source Grok 2.5 baru dengan 4 campuran ahli yang aktif pada saat yang sama dengan sedikit hit kinerja.

Ya, salah satunya adalah Divider Oscillator seperti yang saya gunakan pada tahun 1985 di PC IBM.

Itu dapat menskalakan di 1000-an GPU Nvidia.

Hanya saja, jangan bertanya kepada ahli AI karena mereka akan mengatakan apa yang dikatakan setelan IBM pada tahun 1985.

Tautan:

33,49K

Teratas

Peringkat

Favorit