トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Nvidia AI GPU をターボチャージする: 超高速パフォーマンスを実現する簡単なトリック

私のガレージでは、VC投資家以外の小さな研究開発や仕事をしなければなりませんが、私はペニーを持っていて、何十億もの企業よりも速いスピードを得ています。この制約により、私はより少ないものからより多くのものを絞り出す方法を見つけるようになりました。私はほとんどの人が思いつかないことをたくさんやっています。これは、100 個のうちの 1 つだけの例です。

GPU は強力なものであり、数値を処理できる大量の処理ユニットが満載です。しかし、多くの場合、それらが十分に活用されておらず、パフォーマンスの低下につながります。

私は何を発見しましたか?これらのユニットをブーンと鳴らし続けるスマートな最適化により、AI レンダリング時間が短縮され、速度が大幅に向上します。

まず、ボトルネックを見つけます。

私は Nvidia の Nsight などのプロファイリング ツールを使用して、メモリの待機やその他のものなど、何が物事を妨げているのかを確認します。特定したら、コードを微調整して、各スレッドにより多くの作業を詰め込みます。

ループの展開やデータの圧縮などの単純な変更により、遅延を隠し、スループットを向上させ、瞬時に速度を飛ばすことができます。

使用率が高いとキャッシュの混乱が発生することがありますが、ダミーコードやメモリの調整でスレッド数を賢く減らし、並列タスクにリソースを解放することでキャッシュの混乱を解決します。

本当のゲームチェンジャーは?非同期コンピューティング。複数のタスクを並べて実行し、アイドル状態のギャップを埋め、重い負荷を重ねます。メモリを大量に消費するタスクを組み合わせると、GPU マルチタスクが実現し、時間が半分になり、効率が大幅に向上する可能性があります。

これらの調整により、十分に活用されていない GPU がスピードの悪魔に変わります。これは、IBM PC/AT パーソナル コンピューターが 100 年に工場から出荷されたときに 1986MHz で最大 8MHz で動作するように変貌したのと何ら変わりません。

これについてはさらに詳しく書きますが、大手 AI 企業が私のオペコード レベルの Nvidia GPU 最適化を使用した場合、おそらくすぐに AGI に到達するでしょう。

ハードウェアとソフトウェアをほぼ原子レベルで知れば、第一原理を作り直すことができます。

8月25日 11:14

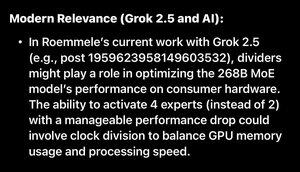

Grok は、新しいオープンソース Grok 2.5 を 4 人の専門家が同時にアクティブにして実行するために行う 7 つのことのうちの 1 つを見つけましたが、パフォーマンスはわずかに低下しました。

はい、1 つは 1985 年に IBM PC で使用したような分周発振器です。

何千もの Nvidia GPU に拡張できます。

AI の専門家は 1985 年に IBM スーツが言ったことを言うので、尋ねないでください。

リンク:

33.48K

トップ

ランキング

お気に入り