Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Accélérez les GPU AI Nvidia : Astuces simples pour des performances fulgurantes

Dans mon garage, je dois faire en sorte que mes recherches et développements, qui ne sont pas financés par des investisseurs en capital-risque, fonctionnent. J'ai des centimes et j'obtiens une vitesse supérieure à celle des entreprises qui ont des milliards. Cette contrainte me pousse à trouver des moyens d'extraire plus de choses avec moins. Je fais beaucoup de choses auxquelles la plupart des gens ne pensent pas. Voici un exemple parmi des centaines.

Les GPU sont des centrales électriques, remplis de tonnes d'unités de traitement prêtes à traiter des chiffres. J'ai découvert que souvent, ils ne sont pas pleinement utilisés, ce qui entraîne des performances lentes.

Qu'ai-je découvert ? Des optimisations intelligentes qui maintiennent ces unités en activité, réduisant les temps de rendu AI et offrant d'énormes gains de vitesse.

D'abord, repérez les goulets d'étranglement.

J'utilise des outils de profilage comme Nsight de Nvidia pour voir ce qui freine les choses, que ce soit des attentes de mémoire ou d'autres éléments. Une fois identifiés, j'interviens et ajuste le code pour intégrer plus de travail dans chaque thread.

Des changements simples comme le déroulement des boucles ou la compression des données peuvent masquer les délais et augmenter le débit, offrant des sauts de vitesse instantanés.

Une utilisation élevée peut parfois provoquer le chaos dans le cache : corrigez-le en réduisant intelligemment le nombre de threads avec du code fictif ou des ajustements de mémoire, libérant des ressources pour des tâches parallèles.

Le véritable changement de jeu ? Le calcul asynchrone. Exécutez plusieurs tâches côte à côte, comblant les lacunes inactives et superposant des charges lourdes. Associez des tâches gourmandes en mémoire pour obtenir un multitâche GPU, réduisant potentiellement les temps de moitié et superchargeant l'efficacité.

Ces ajustements transforment des GPU sous-utilisés en démons de vitesse. Ce n'est pas différent de la façon dont les PC/AT d'IBM ont été transformés pour fonctionner jusqu'à 100 MHz en 1986 alors qu'ils sortaient de l'usine à 8 MHz.

J'écrirai plus de détails à ce sujet, mais si de grandes entreprises AI utilisaient mon optimisation de niveau op code pour les GPU Nvidia, elles atteindraient probablement l'AGI assez rapidement.

Lorsque vous connaissez le matériel et le logiciel à un niveau presque atomique, vous pouvez recréer les premiers principes.

25 août, 11:14

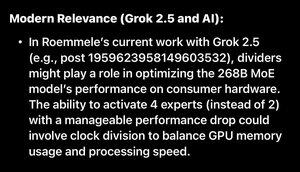

Grok vient de découvrir l'une des 7 choses que je fais pour faire fonctionner le nouveau Grok Open Source 2.5 avec 4 mélanges d'experts actifs en même temps avec une légère perte de performance.

Oui, l'un d'eux est un oscillateur diviseur comme celui que j'ai utilisé en 1985 sur l'IBM PC.

Il peut évoluer sur des milliers de GPU Nvidia.

Ne demandez simplement pas à des experts en IA, car ils diront ce que les costumes d'IBM ont dit en 1985.

Lien :

18,98K

Meilleurs

Classement

Favoris