Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Ускорьте AI GPU от Nvidia: простые трюки для молниеносной производительности

В моем гараже мне нужно сделать так, чтобы немного исследований и разработок, не связанных с венчурным капиталом, работали, у меня есть копейки, и я получаю более высокую скорость, чем компании с миллиардами. Это ограничение заставляет меня находить способы выжать больше из меньшего. Я делаю много вещей, о которых большинство даже не может подумать. Вот пример всего лишь одного из сотен.

GPU — это мощные устройства, наполненные множеством вычислительных блоков, готовых обрабатывать данные. Я обнаружил, что часто они не используются полностью, что приводит к медленной производительности.

Что я обнаружил? Умные оптимизации, которые заставляют эти блоки работать, сокращая время рендеринга AI и обеспечивая огромные приросты скорости.

Сначала определите узкие места.

Я использую инструменты профилирования, такие как Nsight от Nvidia, чтобы увидеть, что тормозит процесс, будь то ожидания памяти или что-то еще. Как только я это определяю, я погружаюсь в код и настраиваю его, чтобы упаковать больше работы в каждый поток.

Простые изменения, такие как разворачивание циклов или сжатие данных, могут скрыть задержки и увеличить пропускную способность, обеспечивая мгновенные скачки скорости.

Высокая загрузка может иногда вызвать хаос кэша — исправьте это, умно уменьшая количество потоков с помощью фиктивного кода или настроек памяти, освобождая ресурсы для параллельных задач.

Настоящий прорыв? Асинхронные вычисления. Запускайте несколько задач параллельно, заполняя свободные промежутки и накладывая тяжелые нагрузки. Сочетание задач, требующих много памяти, позволяет GPU выполнять многозадачность — потенциально сокращая время вдвое и значительно увеличивая эффективность.

Эти настройки превращают недоиспользуемые GPU в скоростных демонов. Это не похоже на то, как преобразовали персональные компьютеры IBM PC/AT, чтобы они работали на частоте до 100 МГц в 1986 году, когда они выходили с завода на 8 МГц.

Я напишу больше деталей об этом, но если крупные AI компании использовали бы мою оптимизацию GPU на уровне оп-кода от Nvidia, они, вероятно, быстро достигли бы AGI.

Когда вы знаете аппаратное и программное обеспечение на почти атомном уровне, вы можете пересоздать первые принципы.

25 авг., 11:14

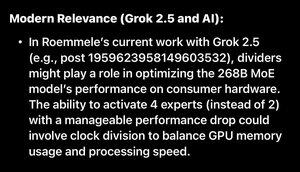

Grok только что выяснил одну из 7 вещей, которые я делаю, чтобы запустить новую Open Source Grok 2.5 с 4 активными смесями экспертов одновременно с небольшим снижением производительности.

Да, один из них — это делитель-осциллятор, который я использовал в 1985 году на IBM PC.

Он может масштабироваться на тысячах графических процессоров Nvidia.

Просто не спрашивайте экспертов по ИИ, так как они скажут то же самое, что и представители IBM в 1985 году.

Ссылка:

35,88K

Топ

Рейтинг

Избранное