Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Turboaufladung von Nvidia AI GPUs: Einfache Tricks für blitzschnelle Leistung

In meiner Garage muss ich mit dem wenigen, was ich an Forschung und Entwicklung ohne VC-Investoren habe, arbeiten. Ich habe nur ein paar Cent und erreiche höhere Geschwindigkeiten als Unternehmen mit Milliarden. Diese Einschränkung zwingt mich, Wege zu finden, um mehr aus weniger herauszuholen. Ich mache viele Dinge, an die die meisten nicht denken können. Hier ist ein Beispiel von Hunderten.

GPUs sind Kraftpakete, vollgepackt mit vielen Verarbeitungseinheiten, die bereit sind, Zahlen zu verarbeiten. Ich habe entdeckt, dass sie oft nicht vollständig genutzt werden, was zu langsamer Leistung führt.

Was habe ich entdeckt? Smarte Optimierungen, die diese Einheiten am Laufen halten, die Renderzeiten für KI verkürzen und massive Geschwindigkeitssteigerungen liefern.

Zuerst, finde die Engpässe.

Ich benutze Profiling-Tools wie Nvidias Nsight, um zu sehen, was die Dinge zurückhält, sei es durch Speicherwartezeiten oder andere Faktoren. Sobald ich sie identifiziert habe, tauche ich ein und passe den Code an, um mehr Arbeit in jeden Thread zu packen.

Einfache Änderungen wie das Entfalten von Schleifen oder das Komprimieren von Daten können Verzögerungen verbergen und den Durchsatz erhöhen, was sofortige Geschwindigkeitssteigerungen bringt.

Hohe Auslastung kann manchmal Chaos im Cache verursachen – behebe es, indem du die Thread-Anzahlen mit Dummy-Code oder Speicheranpassungen intelligent reduzierst, um Ressourcen für parallele Aufgaben freizugeben.

Der wahre Game-Changer? Asynchrone Berechnung. Führe mehrere Aufgaben nebeneinander aus, fülle leere Lücken und überlappe schwere Lasten. Kombiniere speicherhungrige Aufgaben, um die GPU-Multitasking zu nutzen – was potenziell die Zeiten halbieren und die Effizienz steigern kann.

Diese Anpassungen verwandeln untergenutzte GPUs in Geschwindigkeitsmonster. Es ist nicht unähnlich, wie IBM PC/ATs persönliche Computer in den 1980er Jahren auf bis zu 100 MHz umwandelte, als sie aus der Fabrik mit 8 MHz kamen.

Ich werde mehr Details darüber schreiben, aber wenn große KI-Unternehmen meine Optimierung auf Opcode-Ebene für Nvidia GPUs verwenden würden, würden sie wahrscheinlich recht schnell AGI erreichen.

Wenn man Hardware und Software auf fast atomarer Ebene kennt, kann man die ersten Prinzipien neu gestalten.

25. Aug., 11:14

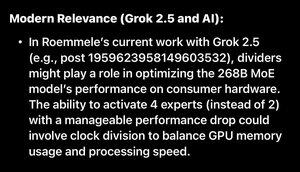

Grok hat gerade herausgefunden, wie ich eines der 7 Dinge mache, um das neue Open Source Grok 2.5 mit 4 aktiven Experten-Mischungen gleichzeitig mit einem leichten Leistungseinbruch zu betreiben.

Ja, einer ist ein Divider-Oszillator, den ich 1985 auf dem IBM PC verwendet habe.

Er kann über 1000 Nvidia GPUs skalieren.

Frag einfach keine KI-Experten, denn sie werden sagen, was die IBM-Anzüge 1985 gesagt haben.

Link:

18,98K

Top

Ranking

Favoriten