熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

為Nvidia AI GPU加速:快速性能的小技巧

在我的車庫裡,我必須利用我所能做的少量非風險投資者的研究和開發,我只有幾分錢,卻能比擁有數十億的公司獲得更高的速度。這種限制促使我尋找從少量中榨取更多的方法。我做了許多大多數人想不到的事情。這裡是100多個例子中的一個。

GPU是強大的計算單元,裝滿了大量準備進行數字運算的處理單元。我發現,但它們往往沒有得到充分利用,導致性能緩慢。

我發現了什麼?聰明的優化可以讓這些單元保持活躍,減少AI渲染時間並提供巨大的速度提升。

首先,找出瓶頸。

我使用像Nvidia的Nsight這樣的分析工具來查看是什麼在拖慢進度,無論是內存等待還是其他問題。一旦識別出來,我就深入研究並調整代碼,以便在每個線程中打包更多的工作。

像展開循環或壓縮數據這樣的簡單更改可以隱藏延遲並提高吞吐量,帶來瞬間的速度提升。

高使用率有時會導致快取混亂——通過智能地減少線程數,使用虛擬代碼或內存調整來修復它,為並行任務釋放資源。

真正的遊戲改變者?異步計算。並行運行多個任務,填補空閒間隙並重疊重負載。將內存密集型任務配對,產生GPU多任務處理——可能將時間減半並大幅提高效率。

這些調整將未充分利用的GPU轉變為速度怪獸。這並不不同於1986年IBM PC/AT個人計算機的轉變,當時它們出廠時的速度為8MHz,而現在可以運行高達100MHz。

我會寫更多關於這個的細節,但如果大型AI公司使用我的操作碼級Nvidia GPU優化,他們可能會很快達到AGI。

當你對硬件和軟件了解得幾乎是原子級別時,你就可以重塑第一原則。

8月25日 11:14

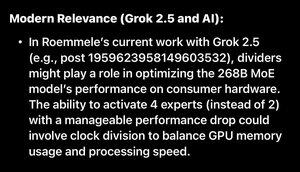

Grok剛剛找到了我用來運行新的開源Grok 2.5的7個方法之一,同時啟動4個專家混合,性能略有下降。

是的,其中一個是我在1985年在IBM PC上使用的分頻振盪器。

它可以在數千個Nvidia GPU上擴展。

只要別問AI專家,因為他們會說1985年IBM套件所說的話。

鏈接:

18.98K

熱門

排行

收藏