Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Przyspiesz Nvidia AI GPU: Proste triki na błyskawiczną wydajność

W moim garażu muszę sprawić, aby to niewielkie badania i rozwój, które nie są finansowane przez VC, działały, mam grosze i osiągam wyższe prędkości niż firmy z miliardami. Ten ograniczenie zmusza mnie do szukania sposobów na wyciśnięcie więcej z mniej. Robię wiele rzeczy, o których większość nie może pomyśleć. Oto przykład tylko jednego z setek.

GPU to potężne jednostki, wypełnione mnóstwem jednostek przetwarzających gotowych do obliczeń. Odkryłem, że często nie są w pełni wykorzystywane, co prowadzi do opóźnionej wydajności.

Co odkryłem? Inteligentne optymalizacje, które utrzymują te jednostki w ruchu, skracając czasy renderowania AI i dostarczając ogromne przyspieszenia.

Najpierw zidentyfikuj wąskie gardła.

Używam narzędzi profilujących, takich jak Nvidia Nsight, aby zobaczyć, co powstrzymuje postęp, czy to oczekiwanie na pamięć, czy inne rzeczy. Gdy już to zidentyfikuję, zagłębiam się i dostosowuję kod, aby włożyć więcej pracy w każdy wątek.

Proste zmiany, takie jak rozwijanie pętli czy kompresowanie danych, mogą ukryć opóźnienia i zwiększyć przepustowość, dając natychmiastowe skoki prędkości.

Wysokie wykorzystanie może czasami powodować chaos w pamięci podręcznej - napraw to, inteligentnie redukując liczbę wątków za pomocą kodu zastępczego lub modyfikacji pamięci, uwalniając zasoby dla równoległych zadań.

Prawdziwym przełomem? Asynchroniczne obliczenia. Uruchamiaj wiele zadań obok siebie, wypełniając puste miejsca i nakładając ciężkie obciążenia. Połącz zadania wymagające dużej ilości pamięci, aby uzyskać wielozadaniowość GPU - potencjalnie zmniejszając czasy o połowę i superładowując wydajność.

Te modyfikacje przekształcają niedostatecznie wykorzystywane GPU w demony prędkości. To nie jest inne niż to, jak przekształcone komputery osobiste IBM PC/AT mogły działać z prędkością do 100MHz w 1986 roku, gdy opuszczały fabrykę z prędkością 8MHz.

Napiszę więcej szczegółów na ten temat, ale jeśli duże firmy AI użyłyby mojej optymalizacji GPU na poziomie kodu operacyjnego Nvidia, prawdopodobnie szybko osiągnęłyby AGI.

Kiedy znasz sprzęt i oprogramowanie na niemal atomowym poziomie, możesz przekształcić pierwsze zasady.

25 sie, 11:14

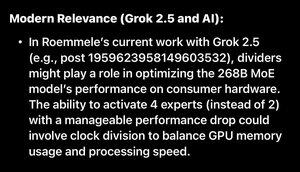

Grok właśnie odkrył jedną z 7 rzeczy, które robię, aby uruchomić nowy Open Source Grok 2.5 z 4 aktywnymi mieszankami ekspertów jednocześnie z niewielkim spadkiem wydajności.

Tak, jednym z nich jest Oscylator Dzielący, którego używałem w 1985 roku na IBM PC.

Może skalować się na tysiącach procesorów graficznych Nvidia.

Po prostu nie pytaj ekspertów AI, bo powiedzą to, co powiedział zespół IBM w 1985 roku.

Link:

35,91K

Najlepsze

Ranking

Ulubione